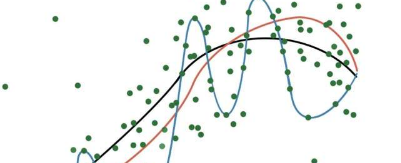

一个国际研究团队在《自然医学》杂志上撰文建议,需要注意不要在医疗保健研究中误用或过度使用机器学习(ML)。我绝对相信ML的力量,但它必须是一个相关的补充,”来自荷兰ErasmusMC大学医学中心的神经外科医生和统计编辑VictorVolovici博士说,他是该评论的第一作者。“有时ML算法的性能不如传统的统计方法,导致发表的论文缺乏临床或科学价值。”

现实世界的例子表明,当机器在有偏见的数据集上进行训练时,医疗保健中算法的滥用可能会延续人类的偏见或无意中造成伤害。

“许多人认为机器学习将彻底改变医疗保健,因为机器比人类做出更客观的选择。但如果没有适当的监督,机器学习模型可能弊大于利,”该评论的资深作者、定量医学中心副教授NanLiu说新加坡杜克-新加坡国立大学医学院的健康服务与系统研究项目。

“如果通过机器学习,我们发现了我们原本看不到的模式——比如在放射学和病理学图像中——我们应该能够解释算法是如何到达那里的,以便进行制衡。”

研究人员与来自英国和新加坡的一组科学家一起强调,尽管已经制定了规范在临床研究中使用ML的指南,但这些指南仅在做出使用ML的决定后才适用,并且不询问是否或者当它的使用首先是合适的。

例如,公司已经成功地训练了机器学习算法,以使用数十亿张图像和视频来识别人脸和道路物体。但是,当涉及到它们在医疗保健环境中的使用时,他们通常会接受数十、数百或数千数据的培训。“这强调了大数据在医疗保健中的相对贫乏,以及努力实现其他行业已经达到的样本量的重要性,以及协调一致的国际大数据共享工作对健康数据的重要性,”研究人员写。

另一个问题是,大多数ML和深度学习算法(不接收关于结果的明确指令)通常仍被视为“黑匣子”。例如,在COVID-19大流行开始时,科学家们发布了一种算法,可以根据肺部照片预测冠状病毒感染。事后证明,算法是根据照片中字母“R”(代表“右肺”)的印记得出结论的,而照片中的字母“R”(代表“右肺”)总是出现在扫描结果稍有不同的位置。

“我们必须摆脱机器学习可以发现我们无法理解的数据模式的想法,”Volovici博士谈到这一事件时说。“机器学习可以很好地发现我们无法直接看到的模式,但是你必须能够解释你是如何得出这个结论的。为了做到这一点,算法必须能够显示它采取了哪些步骤,并且需要创新。”

研究人员建议,在将ML算法用于临床研究之前,应根据传统统计方法(如果适用)对其进行评估。如果认为合适,他们应该补充临床医生的决策,而不是取代它。研究人员写道:“机器学习研究人员应该认识到他们的算法和模型的局限性,以防止过度使用和误用,否则可能会造成不信任并造成患者伤害。”

该团队正在努力组织一项国际努力,为机器学习和传统统计学的使用提供指导,并建立一个可以利用机器学习算法的强大功能的匿名临床数据的大型数据库。

东方时讯网

东方时讯网